![图片[1]-一文搞懂大模型的分词器(Tokenizer) - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/05/20250528_68368cbd8d24b.jpg)

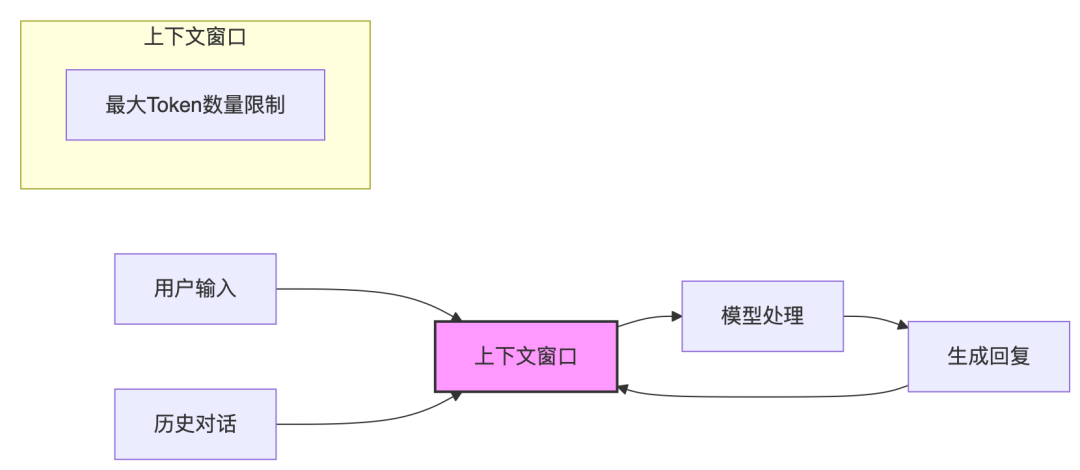

一、BERT(WordPiece)

三、存在问题:

(1)中文适配性差

BERT 原始 Tokenizer 依赖空格分词(如英文),对中文等无显式空格的语言需额外分词预处理。

(2)难以适应动态任务

[CLS]、[SEP] 等特殊标记的语义和位置固定,难以适应动态任务需求(如可变长度的分类任务、多轮对话)。

![图片[4]-一文搞懂大模型的分词器(Tokenizer) - AI资源导航站-AI资源导航站](https://api.ibos.cn/v4/weapparticle/accesswximg?aid=112215&url=aHR0cHM6Ly9tbWJpei5xcGljLmNuL3N6X21tYml6X2pwZy83VFdSaGg0eGlja20xcUR1NGxpYXNJM2liSjluandZa0pJbDVYWTlpYTJVNDQ2ODVsRkZXTnNLUXVGdnQ1bGdXdnBHcUxQYlNqN1RpYmVvVEY0bjNUaWNncjhpY2cvNjQwP3d4X2ZtdD1qcGVnJmFtcA==;from=appmsg)

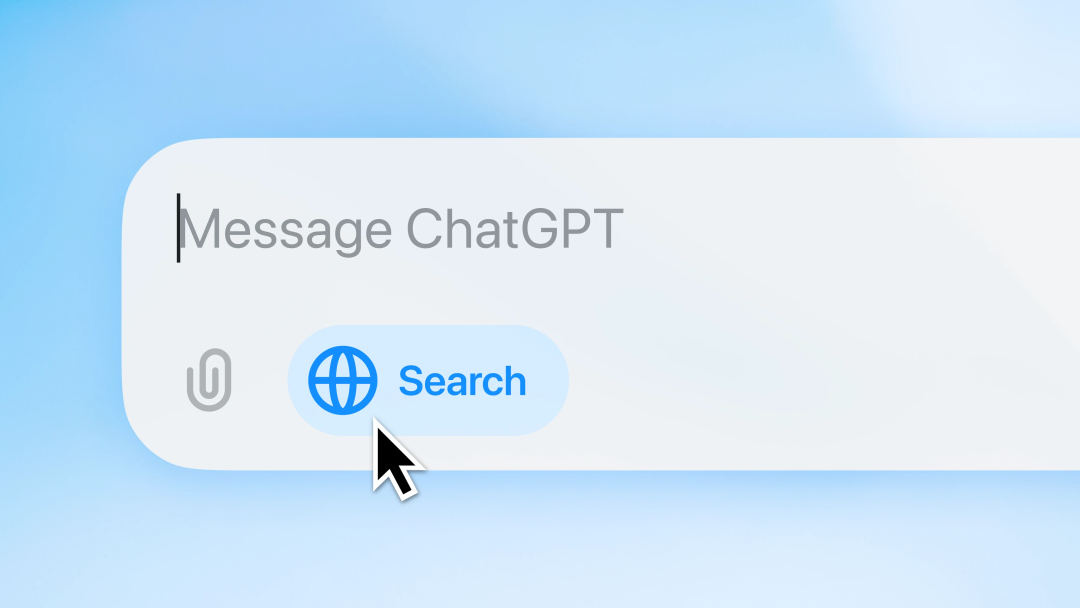

二、GPT(BPE)

三、BPE和WordPiece两者差异:

(1)符号标记

BPE:无特殊标记,直接合并高频子词(如happy)。

WordPiece:依赖##标记后缀(如##ness),拆分规则更严格。

(2)跨语言能力(中英文)

BPE:通过字节级编码统一处理多语言(如pneu+monia)。

WordPiece:需预分词(如中文按字拆分),跨语言泛化性弱。

(3)适用场景

BPE:生成任务(GPT)、多语言混合、非规范文本WordPiece。

WordPiece:理解任务(BERT)、短文本分类、精准语义解析。

![图片[8]-一文搞懂大模型的分词器(Tokenizer) - AI资源导航站-AI资源导航站](https://api.ibos.cn/v4/weapparticle/accesswximg?aid=112215&url=aHR0cHM6Ly9tbWJpei5xcGljLmNuL3N6X21tYml6X3BuZy83VFdSaGg0eGlja20xcUR1NGxpYXNJM2liSjluandZa0pJbDV4bnAwVk1BSEVUU3BxUDlWeUpsZDlNRHRHV1JBTXlONWU3NTRKVEU4ZXRQeXR4enR5bTlKZy82NDA/d3hfZm10PXBuZyZhbXA=;from=appmsg)

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END