最近,AI领域的巨头OpenAI又给我们带来了一个重磅消息。他们在AI代理框架上进行了四项关键更新,这些更新不仅扩展了平台兼容性,还提升了对语音接口的支持,并且增强了可观察性。这些改进都是为了让AI代理更加实用、可控和可审计,以便更好地融入现实世界的各种应用场景,无论是客户端还是服务器端。

1. TypeScript支持:AI开发迎来新选择

首先,OpenAI的Agents SDK现在支持TypeScript了!这意味着除了Python开发者之外,那些在JavaScript和Node.js环境中工作的开发者也可以轻松上手。TypeScript SDK与Python版本功能一致,包括以下几个关键组件:

-

Handoffs(交接机制):可以将执行流程路由到其他代理或进程。 -

Guardrails(防护栏):运行时检查,确保工具行为在预定义的边界内。 -

Tracing(追踪):在代理执行过程中收集结构化遥测数据的钩子。 -

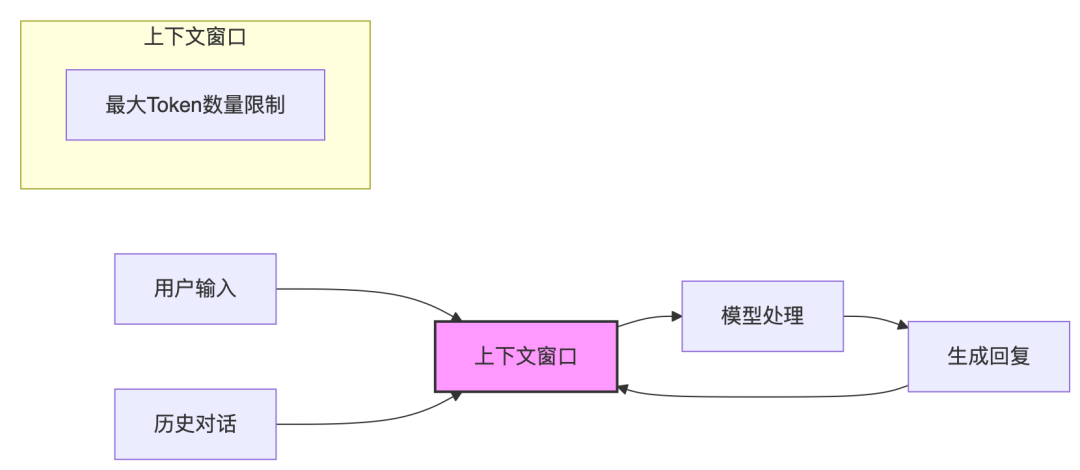

MCP(模型上下文协议):用于在代理步骤和工具调用之间传递上下文状态的协议。

这一更新让SDK与现代Web和云原生应用栈保持一致。开发者现在可以在前端(浏览器)和后端(Node.js)环境中使用统一的抽象来构建和部署代理。详细的文档可以在openai-agents-js找到。

2. RealtimeAgent:实时语音交互的“神器”

OpenAI推出了一种新的RealtimeAgent抽象,专门用于支持对延迟敏感的语音应用。RealtimeAgent扩展了Agents SDK,增加了音频输入/输出、有状态交互和中断处理功能。

其中最值得关注的功能是Human-in-the-Loop(HITL,人在回路中)审批。这个功能允许开发者在运行时拦截代理的执行,序列化其状态,并在继续执行之前要求手动确认。这对于需要监督、合规检查点或特定领域验证的应用场景非常关键。

开发者可以暂停执行,检查序列化状态,并在保留完整上下文的情况下恢复代理。更多细节可以在OpenAI的HITL文档中找到。

3. 实时API会话的可追溯性:让语音代理“有迹可循”

与RealtimeAgent功能相辅相成的是,OpenAI扩展了Traces仪表板,增加了对语音代理会话的支持。现在,无论是通过SDK还是直接通过API调用发起的会话,都可以进行追踪。

Traces界面可以可视化以下内容:

-

音频输入和输出(流式或缓冲) -

工具调用及其参数 -

用户中断和代理恢复

这为基于文本和以音频为主的代理提供了统一的审计跟踪,简化了跨模态的调试、质量保证和性能调优。追踪格式标准化,并与OpenAI的监控栈集成,无需额外的监控工具即可提供全面的可见性。更多实现细节可以在语音代理指南中找到。

4. 语音交互的优化:更自然、更流畅

OpenAI对其底层的语音到语音模型进行了更新,这些模型是实时音频交互的核心。改进主要集中在减少延迟、提高自然度和更有效地处理中断。

虽然模型的核心功能——语音识别、合成和实时反馈——保持不变,但这些改进让对话系统在响应性和语调变化方面表现得更好。具体来说:

-

低延迟流式传输:在口语对话中实现更即时的轮次交替。 -

富有表现力的音频生成:改进了语调和停顿的建模。 -

对中断的鲁棒性:代理可以优雅地响应重叠输入。

这些变化与OpenAI支持动态、多模态环境中运行的具身化和对话型代理的总体努力相一致。

总结:迈向更模块化、更易用的AI代理生态

这四项更新共同加强了构建语音支持、可追溯且对开发者友好的AI代理的基础。通过与TypeScript环境的深度集成,引入实时流程中的结构化控制点,以及增强可观察性和语音交互质量,OpenAI继续朝着更模块化和互操作性强的代理生态系统迈进。

这些更新不仅仅是技术上的进步,更是OpenAI在推动AI技术走向实用化、普及化道路上的重要一步。无论是开发者还是最终用户,都将从这些改进中受益。未来,OpenAI还会带来哪些惊喜?让我们拭目以待!

关注我们,一起进步,一起成长!