编者按:随着大模型技术迅猛发展,传统告警处置流程正迎来革命性变革。本文深入探讨如何将大模型技术与传统告警处置流程有机结合,打造智能化、自动化程度更高的新一代告警处置体系。无论您是IT运维管理者还是技术实践者,这份流程设计都将为您提供宝贵的实践参考。

说明:文中所有截屏内容均为实际操作和真实实践所得,确保每一步均可复现。

在运维领域,告警处置始终是保障系统稳定性的关键环节。传统告警处置主要依赖规则匹配和人工经验,虽然可靠但效率有限。大模型技术的出现打破了这一局面——它不仅能处理结构化数据,更能理解非结构化文本,进行语义分析和深度推理,为告警处置注入全新的智能化元素。

本文提出的告警处置流程框架,并非简单地用大模型替代传统方法,而是构建了”规则引擎+知识库+大模型+智能体“的多层次处置机制。在此框架下,简单和已知告警仍由高效的规则引擎处理,而复杂及未知告警则交由大模型进行深度分析,实现了智能化与可靠性的完美平衡。

新的融入大模型能力的全新告警分析及处置框架及说明,如下所示:

一、告警预处理阶段(针对这部分内容我们将不再赘述)

1. 告警接收

-

功能:接收来自各监控系统的原始告警信息

-

实现:通过统一告警接口,支持多种协议(SNMP、Syslog、HTTP等)接入

-

要点:确保高可用性,支持大批量告警并发接收

2. 告警压缩

-

功能:对重复告警、相似告警进行智能压缩

-

实现:基于时间窗口、相似度算法进行告警去重和聚合

-

要点:减少告警风暴,提高处理效率

3. 告警通知

-

功能:将压缩后的告警分发给相关责任人

-

实现:支持多渠道通知(短信、邮件、企业微信等)

-

要点:根据告警级别、责任人配置智能通知策略

二、告警处置分流

-

功能:根据告警特征及内部的专家经验知识规则库决定走自动处置还是手工触发路径

-

实现:基于告警类型、级别、来源系统等多维度特征进行分流

-

要点:确保重要或复杂告警得到适当处理

三、规则匹配引擎

-

本质定位:规则匹配引擎是组织内重要处置知识的系统化表达和应用载体

-

知识价值:引擎中的每条规则凝聚了组织过往处置经验和专家知识

-

知识管理:通过结构化方式沉淀、管理和应用组织内的告警处置专业知识

-

功能:对告警应用预设规则,实现快速自动化处置

-

实现:基于规则引擎,支持多条件组合匹配

-

知识形态:包括告警特征识别规则、处置决策逻辑、执行策略等形式化知识

1. 自动处置路径

-

自动关闭:对于明确为误报或可忽略的告警直接关闭

-

延期自动关闭:对符合延期条件的告警设置延时关闭

-

延期通知:对符合延期条件的告警配置延期通知策略

如上这些基于规则的运维专家知识,是高效处置告警的有效方法,主要包括:

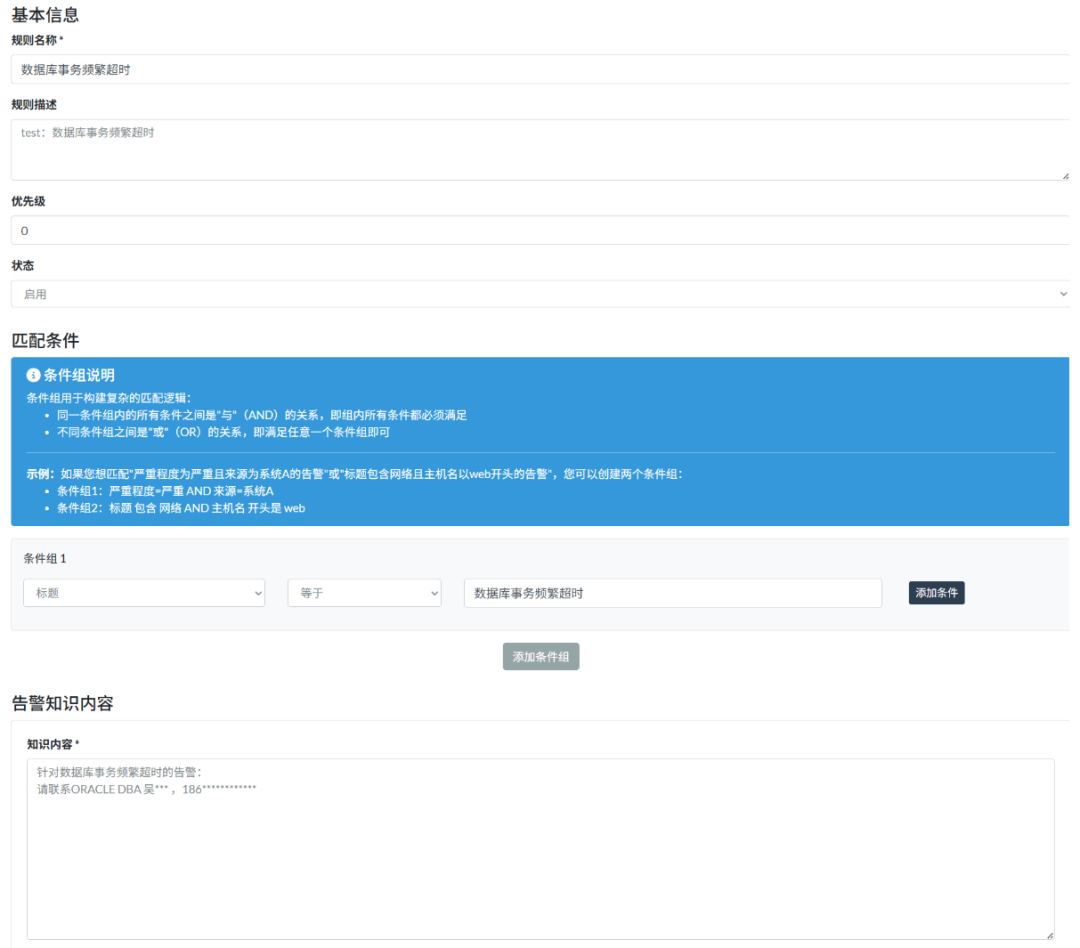

– 基本信息配置

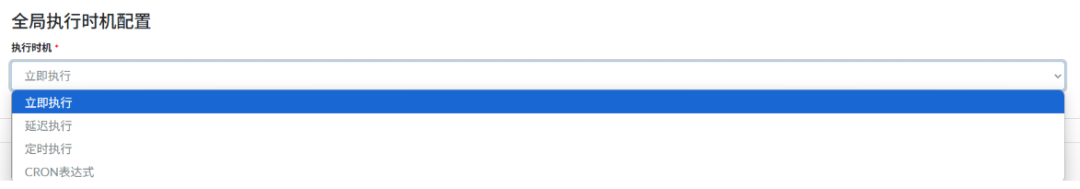

– 执行时机配置

– 条件配置

– 自动化配置:

注意:要关注告警可选择更新字段,更新字段可以直接对满足条件的告警将其状态或相关字段进行修改,也可以选择利用CMDB进行更新,如下图所示:

2. 手工触发路径

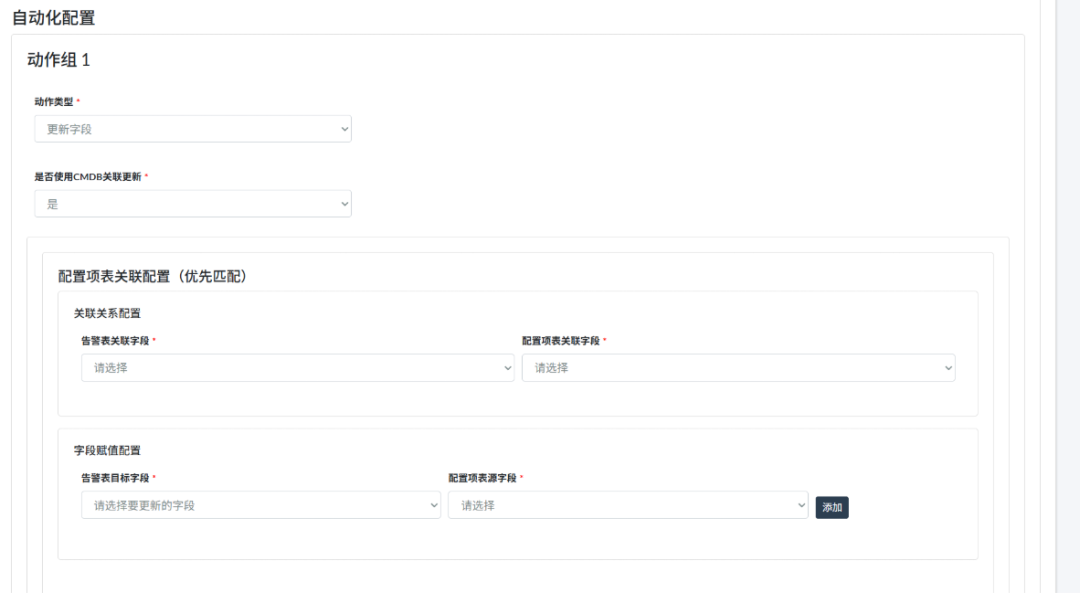

– 相似告警识别:对命中相似告警识别规则的告警进行集中处理

上图为相似告警匹配列表,下图为相似告警配置界面:

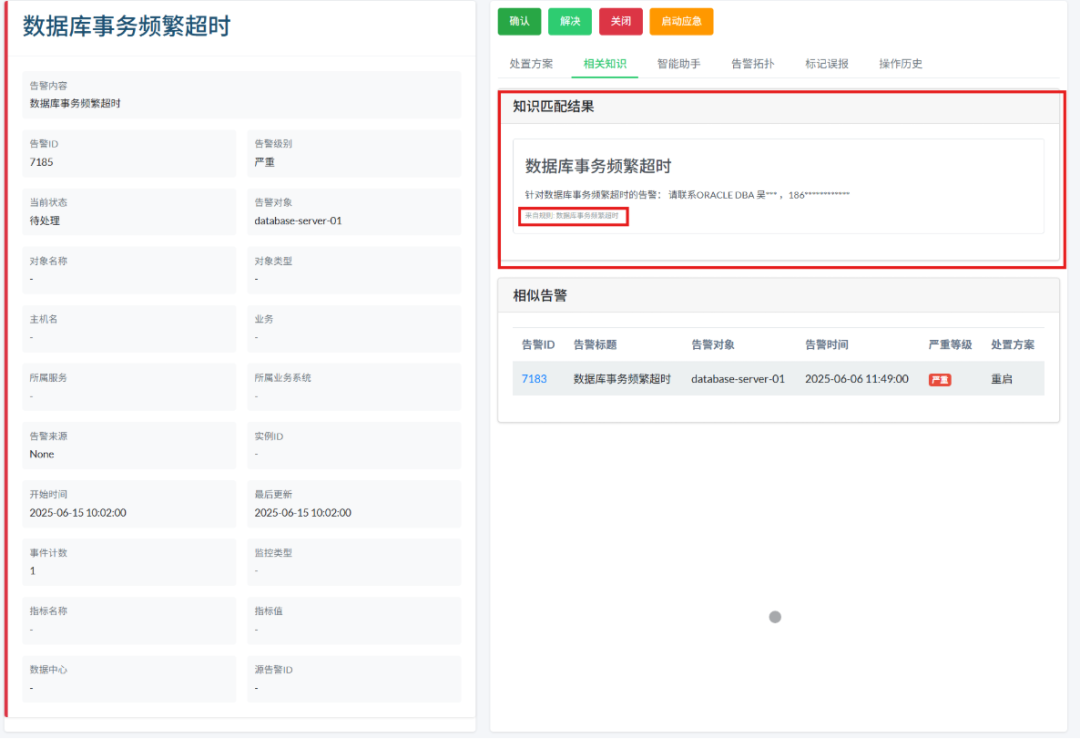

这样就可以在告警详情页面查看与当前告警相匹配的相似告警,如下图所示:

当点击”相关知识”时,系统会即时运行相似告警识别策略,从历史告警中获取时间窗口内满足匹配条件的告警,重点关注其在历史上的”处置方案”,作为借鉴使用。

四、知识匹配与智能分析

1. 基于规则的精确知识匹配处置

-

功能:将告警与精确的处置规则知识库进行匹配

-

实现:基于关键特征提取与知识库查询

-

要点:高精度、高效率的匹配算法

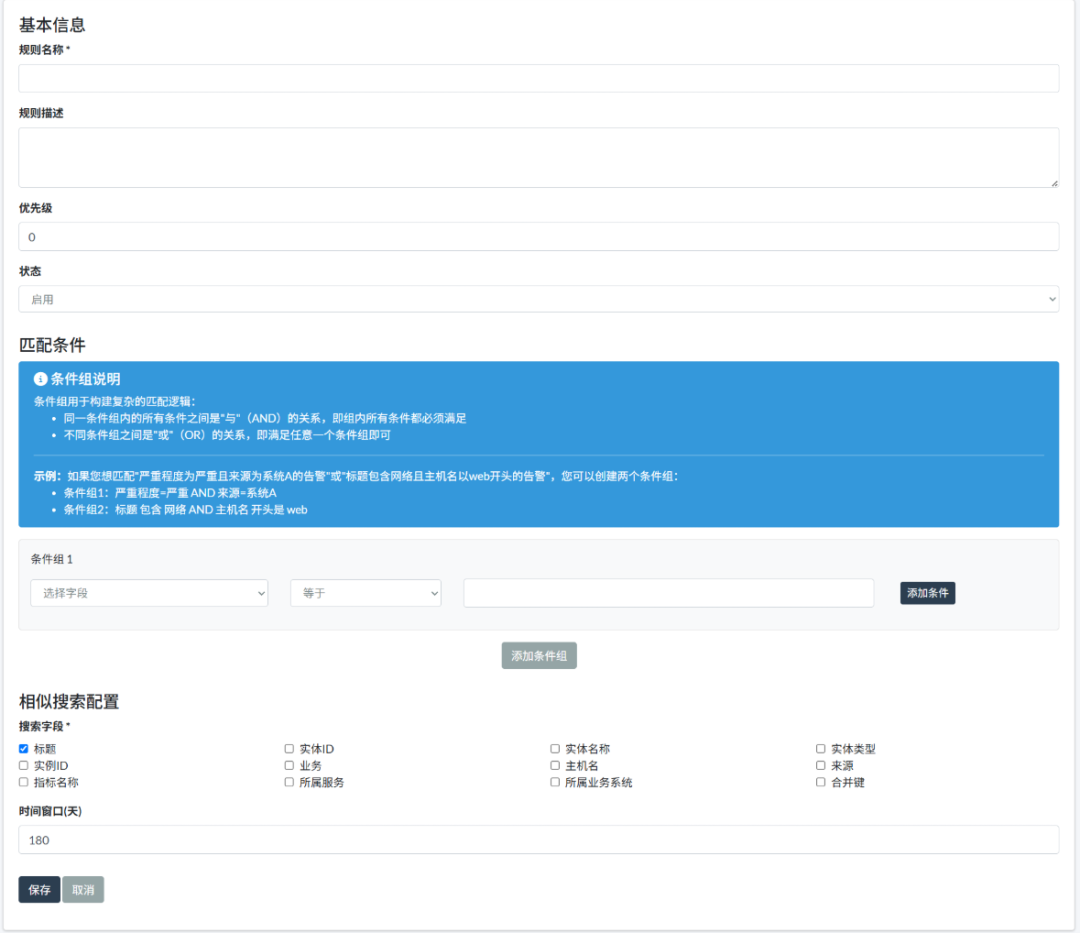

强烈建议组织内部采用该种方案管理告警知识,这是高级运维专家对告警分析处置后总结的核心资产,可配置精确的匹配规则,满足条件时直接使用:

如上为告警知识规则列表,我们按照下图增加一条知识点:

再次查看当前告警时,就会看到如下的结果,如红框所示:

注意:在知识匹配中,基于规则的匹配优先级高于大模型的匹配结果,当规则匹配成功后,就不会再执行大模型的匹配。

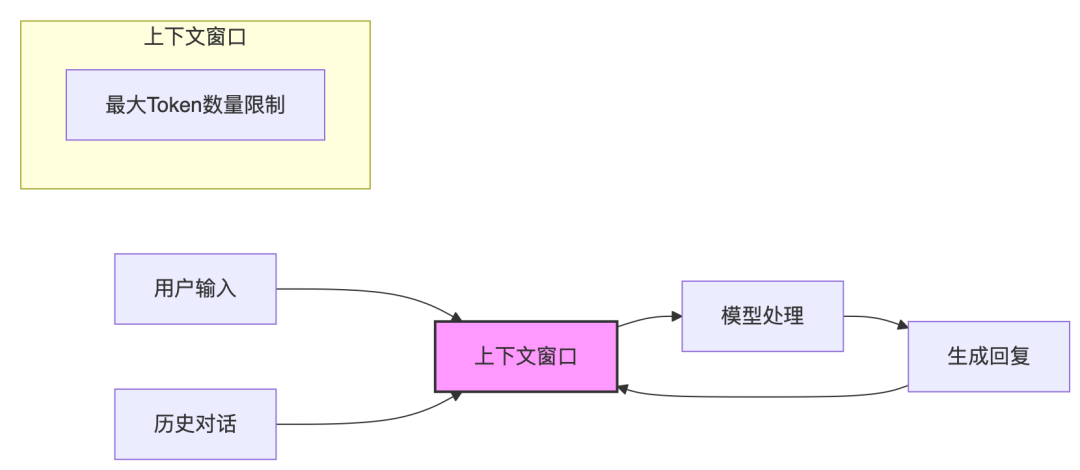

2. 基于大模型的知识匹配处置

-

功能:利用大模型对非明确模式的告警进行语义理解和知识匹配

-

实现:通过大模型理解告警上下文,匹配相似案例

-

要点:模型持续优化、可解释性保障

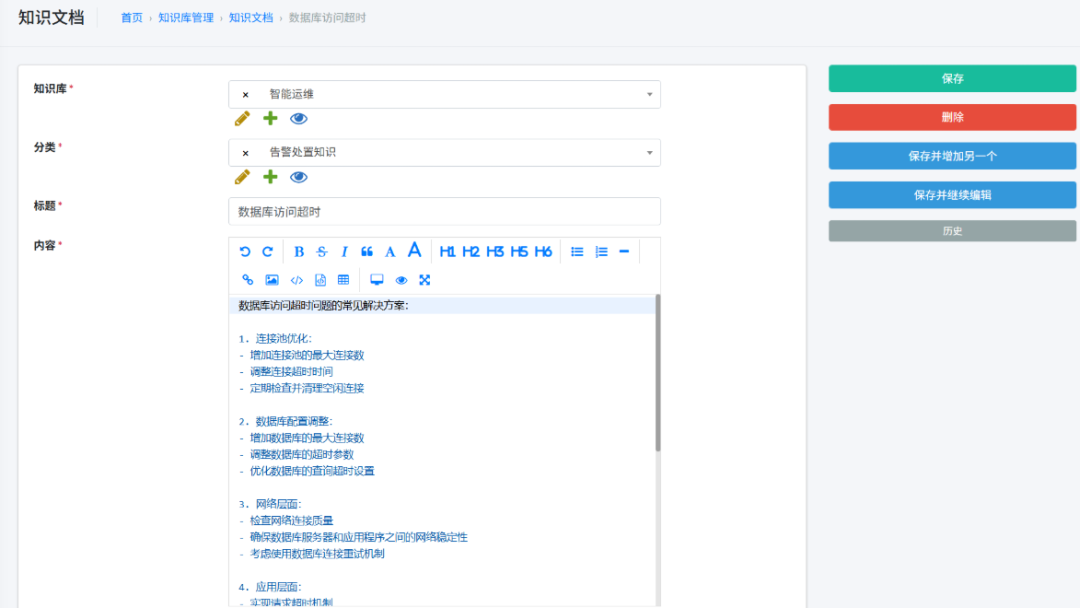

1. 构建知识库流程

-

人工分析和处置告警:运维专家对接收到的告警进行分析和处置,主要包括告警信息和整理好的处置知识点自然语言描述

-

生成处置方案:在此阶段先用大模型将告警标题和内容生成摘要,作为新知识的标题,再加上整理的处置知识,形成完整知识点

-

将知识点添加到告警知识库

如图为知识文档的列表页面,当点击”增加知识文档”按钮时,可添加一条新的知识点,如下图所示:

-

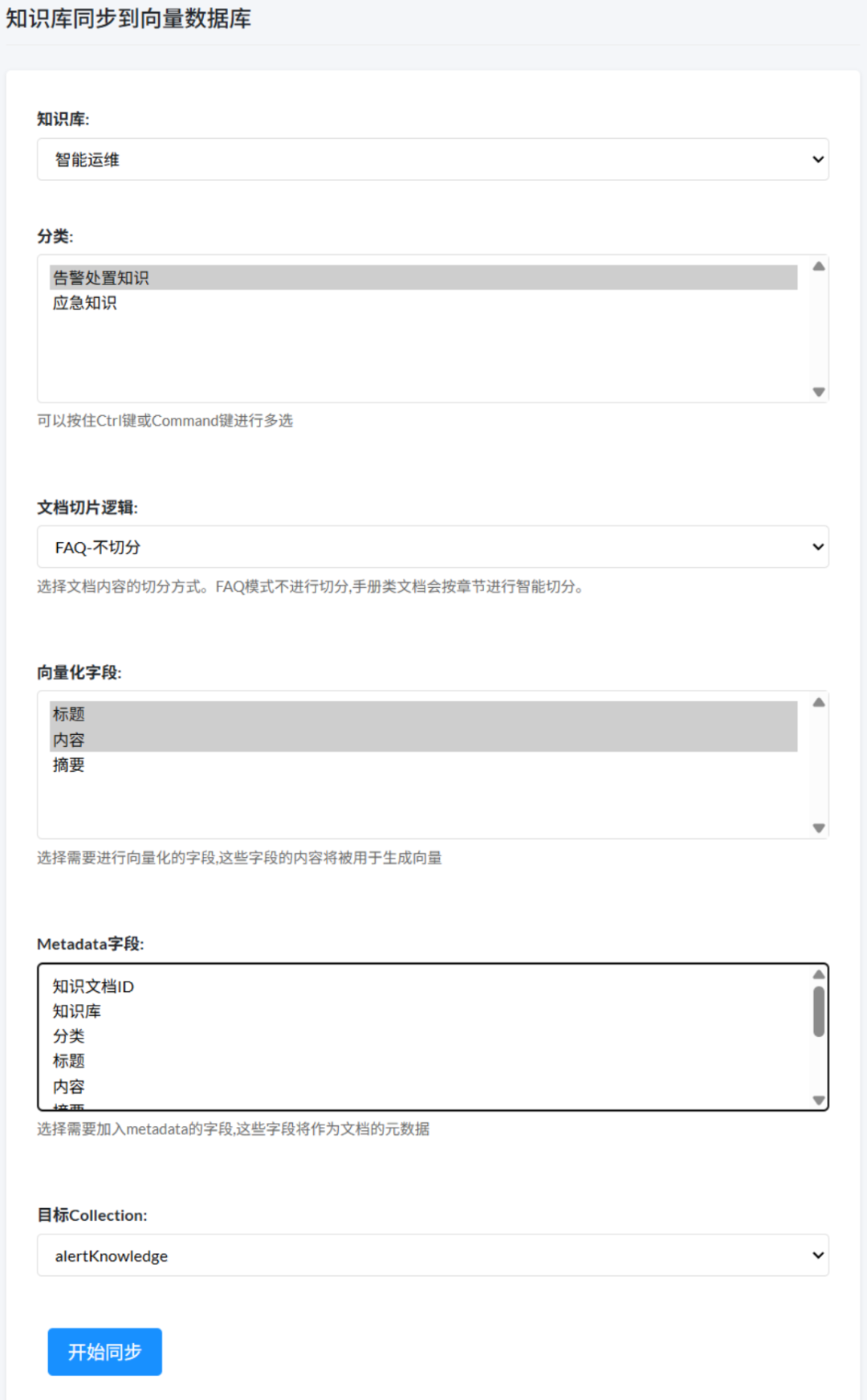

对维护好的告警知识库进行向量化处理,便于后续相似度搜索

最后一步是将知识点增量同步到向量数据库中,这是非常重要的步骤。需要将关系数据库中的知识点同步到向量数据库并进行向量化存储,这里需要选择知识库和分类。文档切片逻辑非常重要,针对告警处置知识,它属于典型的FAQ知识点,通过简短说明提供当前告警的快速恢复及处置策略,一般不需要进行知识分块处理。而针对应急和手册类文档则可选择”手册类文档”,系统内置了对这类运维文档的分块处理策略,无需调整任何分块参数即可使用。向量化字段也非常重要,对于FAQ建议选择标题和内容同时进行向量化处理。metadata字段是向量化后建立与原文关联的重要信息,建议至少选择知识文档ID,如需用metadata进行过滤,则适当选择其它字段。

点击”开始同步”即可完成对增量知识文档的同步。

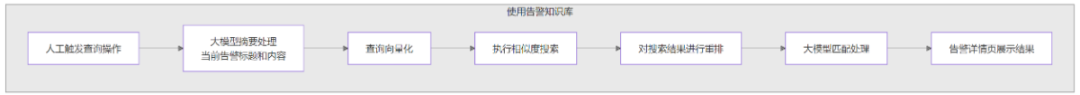

2.使用知识库流程

-

运维人员在处理告警时触发知识查询

-

大模型摘要处理:系统使用大模型对当前告警标题和内容进行摘要

-

查询向量化:将用户查询内容(系统自动获取告警的标题和告警内容)转换为向量形式

-

执行相似度搜索:在向量数据库中寻找相似的知识点

-

搜索结果重排:根据相关性、时效性等因素对搜索结果进行重排

-

大模型匹配处理:大模型对重排结果进行进一步分析和匹配

-

告警详情页展示结果:将最终匹配的知识点和处置方案展示在告警详情页

3. 基于智能体的交互式智能分析

在规则匹配和大模型知识检索都无法找到知识的情况下,智能体交互式分析作为”最后一道防线”,为运维人员提供更深层次的告警诊断能力。

功能定位

-

兜底机制:当规则引擎和知识库均无法匹配时可以人工手动触发

-

深度诊断:针对复杂、非常规或首次出现的告警提供分析

-

交互式探索:通过对话形式引导运维人员进行告警分析诊断

实现方式

-

动态对话能力:基于大模型实现的多轮对话,支持追问和澄清

-

工具调用集成:通过自然语言指令触发系统命令、日志查询、监控数据获取等操作

-

历史案例关联:即使无精确匹配,仍能关联相似历史案例提供参考

-

多维度分析:结合告警上下文、系统状态、时序信息进行综合推理

运行示例

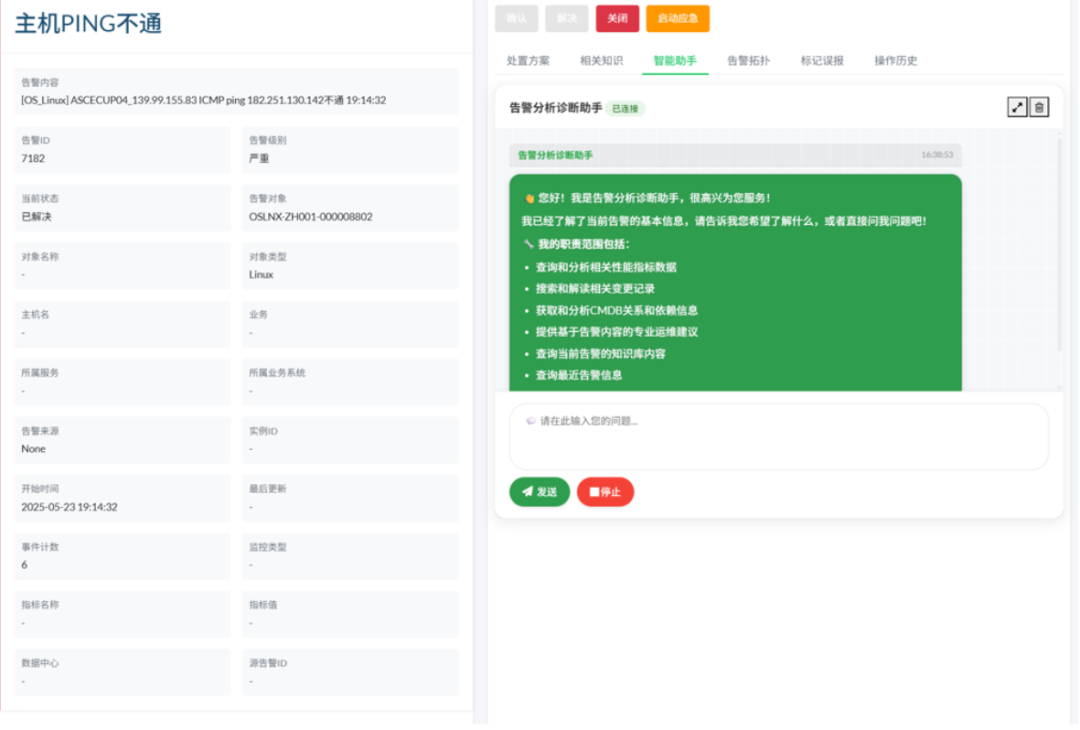

如图所示,我们实现的告警分析诊断智能体系统成功处理了”主机PING不通”的网络告警:

在告警详情页面中,系统提供了”智能助手”标签,用户可通过此入口激活告警分析诊断智能体。在初次进入时,智能体会向用户展示其核心能力范围,包括(这是根据智能体所提供的工具能力来界定的):

-

查询相关性能指标数据

-

查询和解读相关变更记录

-

获取和分析CMDB关系和依赖信息

-

提供基于告警内容的专业运维建议

-

查询当前告警的知识库内容

-

查询最近告警信息

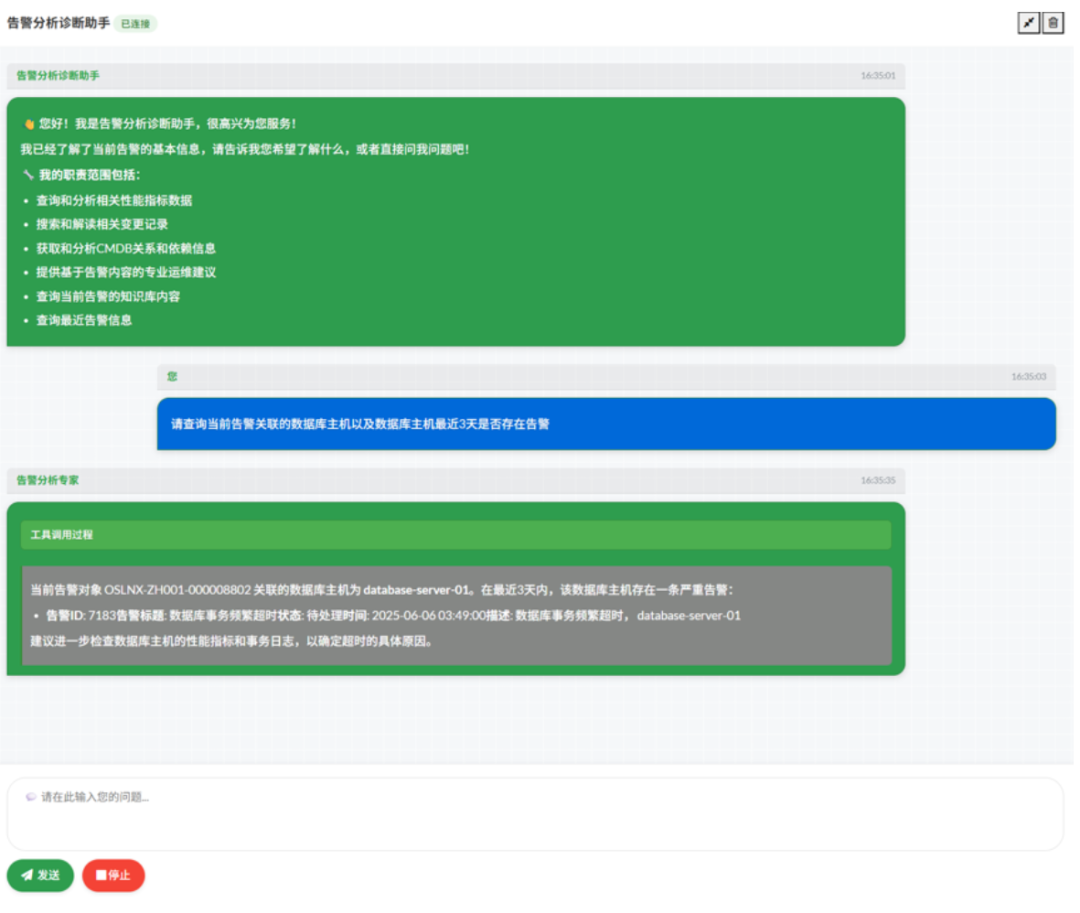

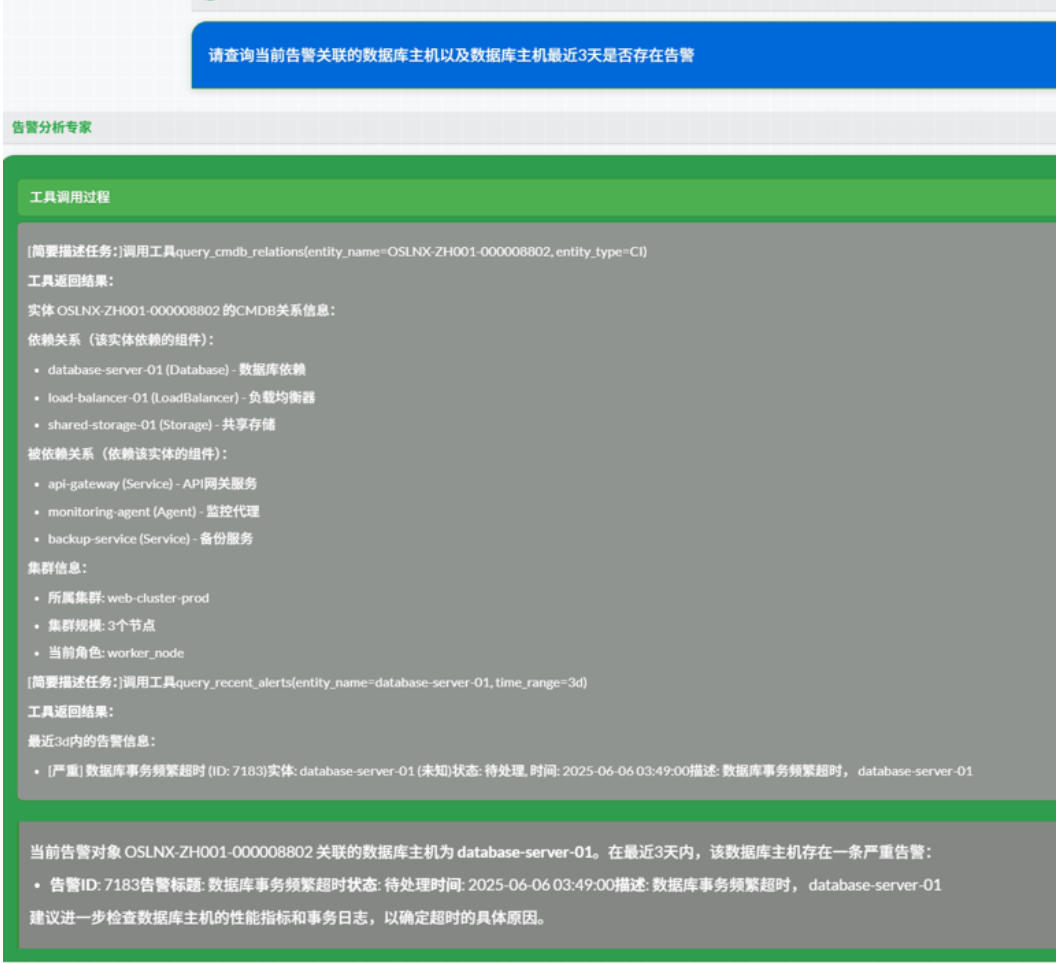

复杂指令理解、遵循及任务分解能力示例:查询告警关联数据库主机以及最近3天的告警

如上图所示,该系统提供了一个复杂的智能查询功能,主要包含两个核心任务:

1. 通过CMDB关系查询能力,调用Agent工具查询当前告警关联的数据库主机信息

2. 基于查询到的数据库主机,利用AGENT调用告警工具查询最近3天的告警记录

用户可以点击”工具调用过程”按钮查看详细的工具调用链路,如下图所示:

我们对该故障案例进行了深入测试,包括工具调用、变更查询和告警知识库查询等场景,共计30余轮测试。结果表明,DeepSeek-chat模型表现优异:

-

指令理解与执行(函数调用参数提取与赋值)准确率达到92%以上

-

整体表现稳定可靠

-

支持多轮对话能力,前后一致性良好

基于测试结果,我们有理由相信,通过进一步优化提示词工程,该系统在生产环境中将发挥更大的价值。

五、后续步骤

-

生成方案:智能运维平台会根据前序分析结果(规则匹配、知识库检索或智能体分析),生成针对性的处置方案,为后续处置提供重要依据。

-

人工/自动化处理:根据生成的方案,可进行人工或系统自动化处置。

-

告警关闭与记录:最终完成告警关闭并记录详细的处置方案,为未来类似告警提供参考。

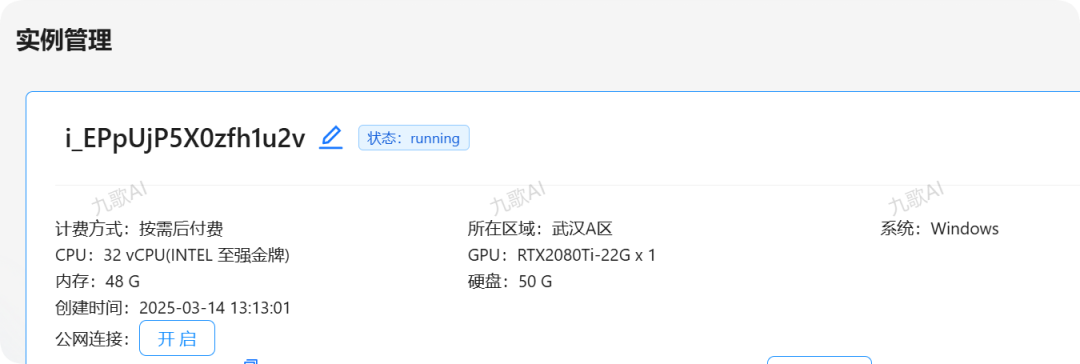

六、相关环境及模型推荐

|

|

|

|

|

quentinz/bge-large-zh-v1.5:latest ,开源且比较好地支持中文 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

具体选择标准,可以参见:

通过将规则引擎、知识库、大模型与智能体有机结合,本文提出的新一代智能告警处置体系,不仅实现了自动化与智能化的深度融合,还极大提升了运维效率和告警处理的准确性。未来,随着大模型和智能体技术的持续演进,智能告警处置体系将更加完善和高效,助力企业构建更具韧性和竞争力的IT运维能力。建议各组织积极拥抱新技术,持续优化告警流程,不断积累和沉淀运维知识,推动智能运维迈向更高水平。