![图片[1]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef8fbdd20.png)

Transformer和大模型之间是什么关系?

-

火力猛:能同时处理大量信息(比如一句话的所有词语一起分析,而不是逐个字看); -

步骤简:用“注意力机制”(Attention)自动找到关键信息(比如理解“猫吃鱼”时,自动关联“猫→吃→鱼”的关系); -

可复制:这套方法能无限扩展,锅越大(模型参数越多),菜越香(效果越好)。

![图片[2]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef90c80bb.png)

Transformer到底是什么?

![图片[3]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef91a96f1.png)

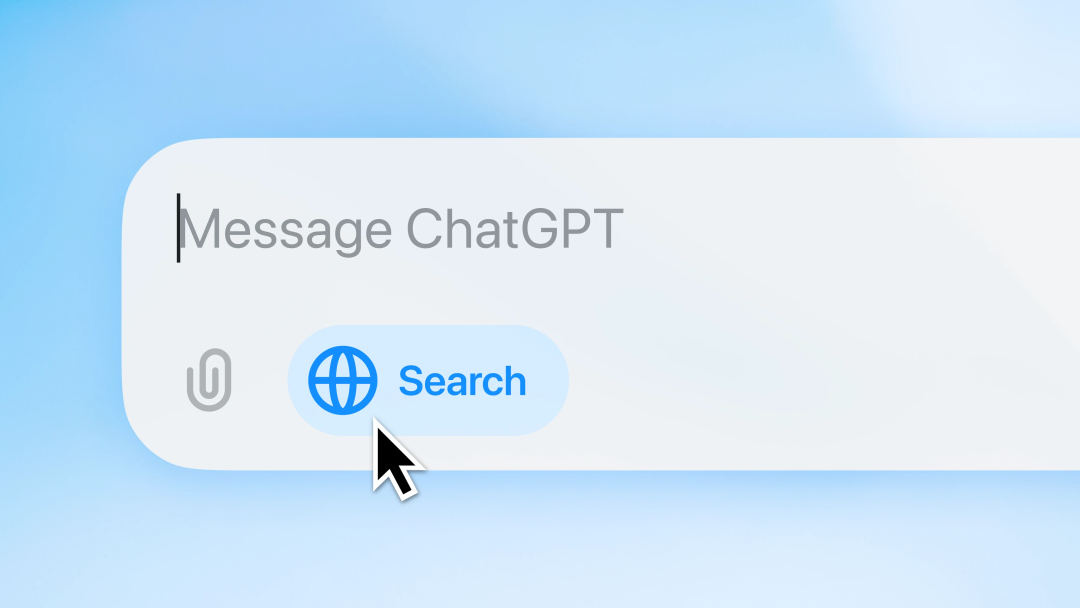

Transformer内部结构

![图片[4]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef924cf2e.png)

Transformer输入句子处理

![图片[5]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef92a545f.jpg) 表示,其中n为句子中的单词数量,d为向量的维度,论文中的d=512

表示,其中n为句子中的单词数量,d为向量的维度,论文中的d=512![图片[6]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9308948.jpg)

Transformer编码图解

![图片[7]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef93903d8.png)

Transformer编码图解

![图片[8]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef94031a7.png)

Encoder和Decoder的核心原理是什么?

![图片[9]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef952e016.png)

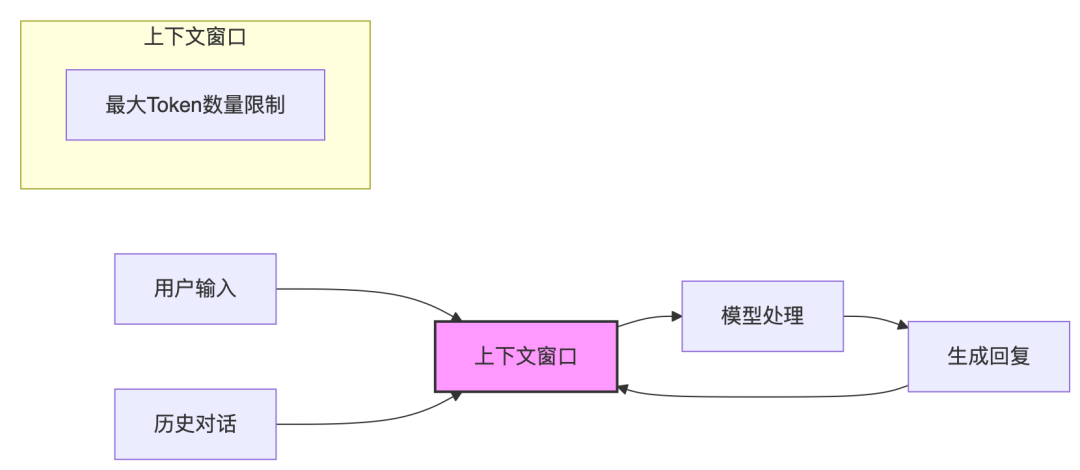

Self-Attention 流程图

![图片[10]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef958ccaf.png)

-

4.1.1 公式含义

![图片[11]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef95f17d5.jpg) 这个公式是什么含义呢?

这个公式是什么含义呢?![图片[12]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef96865f9.png)

![图片[13]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9735c0d.jpg) 的结果是一个矩阵,它里面保存了每个向量与自己、以及其他向量进行内积的计算结果。至此,我们了解了一个矩阵乘它自己转置矩阵的含义,那我们再来看softmax的作用是什么?

的结果是一个矩阵,它里面保存了每个向量与自己、以及其他向量进行内积的计算结果。至此,我们了解了一个矩阵乘它自己转置矩阵的含义,那我们再来看softmax的作用是什么?![图片[14]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef97931bc.png) ,那最后的乘X是什么作用呢?如下图所示

,那最后的乘X是什么作用呢?如下图所示![图片[15]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef98264e6.png)

![图片[16]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef987fdb2.jpg) ,为什么要除

,为什么要除![图片[17]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef991cd46.jpg) 呢?其实这个操作只是为了防止QK的结果过大,所以会除一个尺度标度

呢?其实这个操作只是为了防止QK的结果过大,所以会除一个尺度标度![图片[18]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9977d55.jpg) ,而

,而![图片[19]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef99da9c0.png) 表示query和key的向量的维度,如果不对softmax的输入做缩放,那么万一输入的数量级很大,softmax的梯度就会趋向于0。

表示query和key的向量的维度,如果不对softmax的输入做缩放,那么万一输入的数量级很大,softmax的梯度就会趋向于0。-

4.1.2 Q K V含义

![图片[20]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9ad2a8b.png)

Q K V矩阵计算

![图片[21]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9b8183b.png)

Multi-Head Attention机制

![图片[22]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9bd6d1a.jpg) 将Q、K、V分割,每个Head单独计算self-attention,同时因为训练出的

将Q、K、V分割,每个Head单独计算self-attention,同时因为训练出的![图片[23]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9c4478e.jpg) 也各不相同,所以得出的Q、K、V也是不同的,因此我们说每个Head的关注点也各有侧重。最后将每个Head得出的结果进行Concat(拼接)操作,然后通过总体权重矩阵

也各不相同,所以得出的Q、K、V也是不同的,因此我们说每个Head的关注点也各有侧重。最后将每个Head得出的结果进行Concat(拼接)操作,然后通过总体权重矩阵![图片[24]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9c9676d.png) 决定对每个Head结果的关注程度(注意最后的Z矩阵维度和最初输入的X维度相同),从而能够做到在不同语境下对相同句子的不同理解。具体图解如下图所示。

决定对每个Head结果的关注程度(注意最后的Z矩阵维度和最初输入的X维度相同),从而能够做到在不同语境下对相同句子的不同理解。具体图解如下图所示。![图片[25]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9d729a8.png)

Multi-Head Attention计算流程

![图片[26]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9dccb06.png)

![图片[27]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9ea0740.png)

Transformer内部结构

![图片[28]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9f0f637.png)

-

使用公式法能够适应比训练集里所有句子更长的句子场景,这么说可能有点绕,举一个例子,假设我们训练的时候,训练集里最长的句子只有100个单词,但是现实中我们在推理的时候,可能会存在101个单词的场景,这时候呢根据公式就可以计算出101单词的位置信息。 -

可以让模型更容易地计算出相对位置。举一个例子,假设A单词的位置是pos, B单词和A单词之间的位置距离为L,那么PE(pos+L)则可以由PE(pos)计算得到。因为Sin(A+B) = Sin(A)Cos(B) + Cos(A)Sin(B), Cos(A+B) = Cos(A)Cos(B) – Sin(A)Sin(B)

![图片[29]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fef9f7a846.png)

Encoder的组成

![图片[30]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa0d920f.png)

Encoder架构

![图片[31]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa153b47.png) 通过公式,其实不难得出,FFN是由全连接层(FC)和激活函数Relu组成。其实通过分析公式,已经可以得出FFN的作用,即对矩阵进行空间的变换,引入非线性特征,来增强模型的表现能力。

通过公式,其实不难得出,FFN是由全连接层(FC)和激活函数Relu组成。其实通过分析公式,已经可以得出FFN的作用,即对矩阵进行空间的变换,引入非线性特征,来增强模型的表现能力。![图片[32]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa22a68e.png) FFN模块架构图

FFN模块架构图![图片[33]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa28df70.png) 的计算,已经将结果映射成和输入X相同维度了,为什么这里还要增加一个FFN模块?笔者认为这里是把向量先线性变化到高维空间再重新变换回来可以得到更加抽象的数据,泛化效果更好。当然把FFN模块去掉也可以使用,但是效果差了很多。(笔者观点,有待讨论~)

的计算,已经将结果映射成和输入X相同维度了,为什么这里还要增加一个FFN模块?笔者认为这里是把向量先线性变化到高维空间再重新变换回来可以得到更加抽象的数据,泛化效果更好。当然把FFN模块去掉也可以使用,但是效果差了很多。(笔者观点,有待讨论~)![图片[34]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa300a21.png)

![图片[35]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa35923e.jpg) 矩阵保证了输出和输入相同维度。

矩阵保证了输出和输入相同维度。![图片[36]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa3b77d4.png)

残差网络

![图片[37]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa41616d.png)

-

Decoder存在两个Multi-Head Attention模块,而Encoder只有一个 -

Decoder的第一个Multi-Head Attention模块采用了Mask操作 -

Decoder的第二个Multi-Head Attention模块的输入,并不止依赖于第一个Multi-Head Attention模块的结果,同时依赖了Encoder的输出(后面会详细解释)

![图片[38]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa575aa1.png)

Decoder架构

![图片[39]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa634bfa.png)

![图片[40]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa698204.png) 矩阵后,再将其与Mask矩阵进行按位相乘,即可得到一个带有掩码的矩阵结果(黑色部分为0值),后续再乘V矩阵即可得到最终的self-attention的结果。

矩阵后,再将其与Mask矩阵进行按位相乘,即可得到一个带有掩码的矩阵结果(黑色部分为0值),后续再乘V矩阵即可得到最终的self-attention的结果。![图片[41]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa7ef2df.png)

Decoder架构

![图片[42]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/20250616_684fefa85fec7.png)

![图片[43]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/accesswximgaid114964urlaHR0cHM6Ly9tbWJpei5xcGljLmNuL21tYml6X3BuZy8zM1AyRmRBbmp1aWJVZHlpYnZhOXV0OVFVa2d0QmdnQmVGbGlhT0VXSGF5NFBRN2FScVN4bFFQcmJSWk51Q3pOUlNpYjJKZmN0QUFKYTVNTFJwTHNLRUpmVFEvNjQwP2Zyb209YXBwbXNn.png)

![图片[44]-零基础解码Transformer与大模型核心原理 - AI资源导航站-AI资源导航站](https://www.aitube.vip/wp-content/uploads/2025/06/accesswximgaid114964urlaHR0cHM6Ly9tbWJpei5xcGljLmNuL21tYml6X3BuZy8zM1AyRmRBbmp1aWJiMHg2Y2dYSnZodXIxaWJza3NuaWF5czJLWXBnOHBqUTBiZTNadWJPalpPUHh2NTd0aWJ0YmJhQ3NhWk5KcXV2N3MwNGRjUEU2eGJIelEvNjQwP3d4X2ZtdD1wbmcmYW1wwxfrom5wx_lazy1wx_co1tpwebp.png)

-

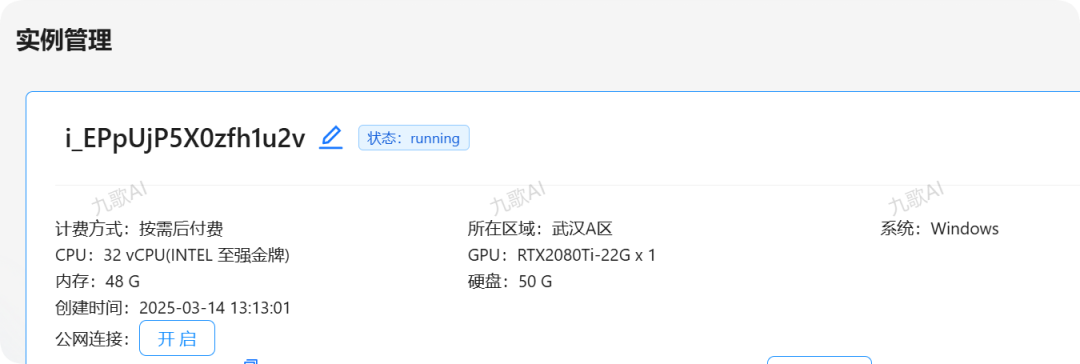

Encoder用来对输入序列进行高纬度特征提取,并生成编码后的向量信息 -

因为Encoder获取不到序列之间的位置信息,所以需要位置编码模块对其进行位置特征的补充,从而让模型能够拥有语义信息+位置信息的特征 -

Decoder基于已生成的结果和Encoder的输入进行生成最终目标序列

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END