1

介绍

想象一下,每次买新设备都要发明一个新插头来供电。

这就是使用 LLM 之前的情况 —— 每个应用都得自己想办法连接模型、数据、工具和其他系统。

Model Context Protocol (MCP) 就是 AI 应用的通用适配器。

MCP 是一个开放协议,它统一了大型语言模型 (LLM) 与工具、数据源和工作流的交互方式。

就像 AI 界的蓝牙 —— 一种通用语言,让模型能够『配对』各种功能,不管是谁开发的,也不管在哪里。

无论是处理本地文件,还是调用云端 API,MCP 都能让你轻松地把所有东西连到 AI 工作流中。

2

为什么 MCP 很重要

用 LLM 开发不再只是生成文本 —— 而是要完成实际任务。为此,模型需要访问训练数据之外的世界。

MCP 通过几个关键特性提供了这种能力:

- 即插即用的智能

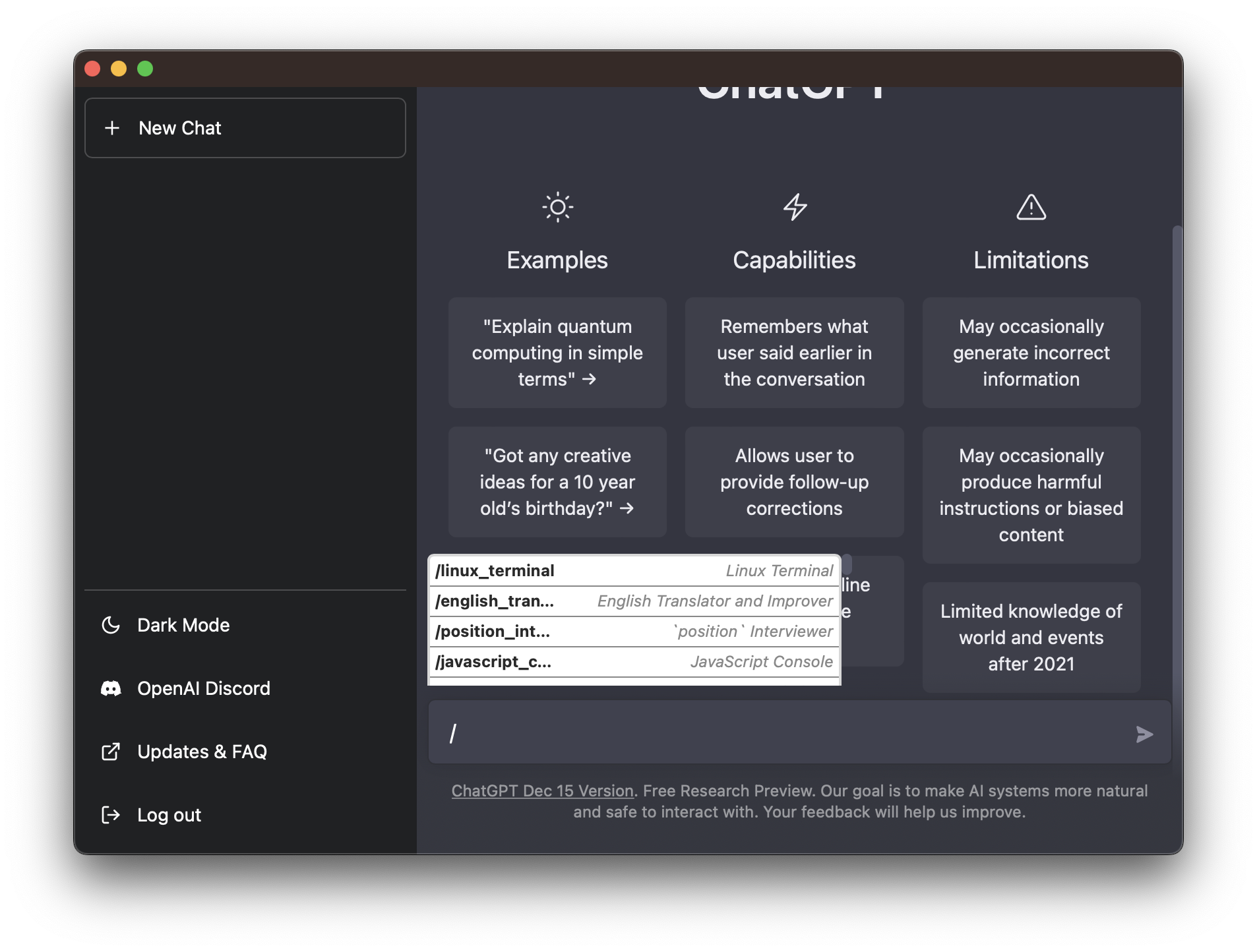

MCP

提供了丰富的内置集成库和标准接口。想让模型查天气或分析代码?直接通过 MCP接入工具就行 —— 不用写额外的代码。 - 跨平台兼容

不管用 Claude、OpenAI还是其他模型,MCP都能让你的工具通用。就像写一个能在Windows、macOS和Linux上直接运行的脚本。 - 安全可靠

数据完全由你掌控。 MCP服务器就在你的基础设施里,模型只能访问你允许的内容。就像代客泊车钥匙 —— 功能强大但有限制。 - 支持智能工作流

MCP

让被动的 LLM变成主动助手。通过访问工具和数据,模型可以执行多步骤任务、获取实时信息、自动化流程 —— 全程都在你的监督下。

3

MCP 如何工作

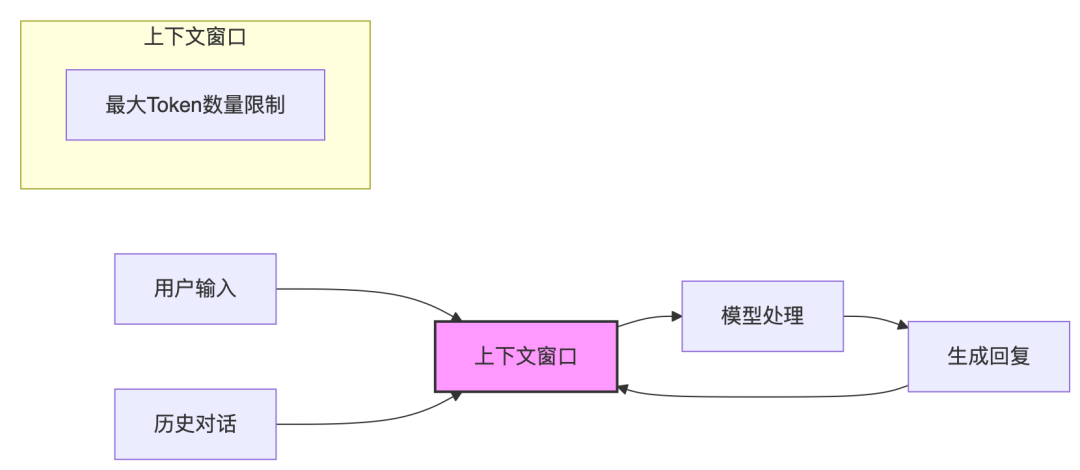

MCP 的核心是一个简单但强大的客户端-服务器架构,用来连接语言模型和现实世界功能。

就像一家餐厅:

- 主机 (host)

(比如 Claude Desktop或其他LLM应用)是服务员,负责接收请求。 - 客户端 (client)

是厨房经理,决定把订单分给哪个工作站。 - 服务器 (Server)

是厨师,每个厨师负责特定菜品 —— 在 MCP里,就是特定的工具或数据源。

这些组件是这样配合的:

- MCP Host

是 LLM驱动的应用,比如Claude for Desktop或未来的 AI 集成IDE。这是用户提问或发起操作的入口。 - MCP Client

负责连接管理。每个客户端对应一个服务器,处理通信和协调。 - MCP Server

提供各种功能:从文件访问到天气 API,每个服务器都通过标准接口提供特定工具、资源或提示。

MCP 服务器提供三种主要功能:

- 工具 (tool)

—— 模型可以调用的函数,比如『查天气』或『运行命令』。由 LLM决定什么时候用。 - 资源 (Resource)

—— 包括文件、日志或 API响应。模型可以读取但不能修改。客户端决定什么时候展示。 - 提示词 (Prompt)

—— 预置的交互模板。比如让模型生成提交信息或指导调试。通常由用户选择。

MCP 用标准方式在组件间传输数据。开发人员通常用 stdio 处理本地工作流,用 HTTP/SSE 处理网络环境。所有通信都用 JSON-RPC 2.0,既容易读也容易调试。

这些元素共同构成了一个灵活、可扩展的生态系统,让模型、工具和数据无缝协作 —— 不用把基础设施绑定到特定供应商或工作流。

实际案例

假设你要给公园管理员开发一个虚拟助手 —— 需要实时监控天气、跟踪野生动物、处理紧急情况。

传统做法是把天气 API、本地表格、位置数据等用代码硬拼在一起 —— 每个系统都要写专门的逻辑。

用 MCP 的话,就像搭积木一样简单:

- 天气服务器

就像管理员的对讲机。它提供的工具(tool)包括 get-alerts和get-forecast,用来获取气象局数据。 - 野生动物跟踪服务器

提供资源,显示最近发现的动物。 -

如果发生野火,提示 会指导管理员填写事件报告。

管理员(或他们的 AI 助手)只要打开连接了 MCP 服务器的 Claude for Desktop。问一句『大兴安岭明天天气怎么样?』,助手就知道该用什么工具、怎么回答。

不用预先训练模型使用天气 API,也不用把数据交给第三方。每个工具都是独立的组件,可以随时替换。助手功能强大但不会变得复杂。

这就是 MCP 的厉害之处:它把复杂的工作流变成了 LLM 的即插即用体验,让 AI 在需要时能调用合适的工具。

4

结论

Model Context Protocol 正在改变我们使用语言模型的方式 —— 不是让模型更聪明,而是让它们的环境更智能。

MCP 不靠硬编码集成,也不暴露敏感数据给第三方 API,而是提供了一种模块化、安全、标准的方式,让 LLM 与现实世界互动。它把模型从被动的文本生成器变成了主动助手,能获取数据、运行工具、指导工作流 —— 全程都在你的掌控中。

无论是开发个人助手、程序员帮手,还是企业级 AI 工具,MCP 都能让你灵活组合各种功能,不用担心被供应商锁定或架构拖累。

在快速发展的 AI 世界里,MCP 不预测未来,只确保你随时准备好迎接未来。

想了解更多或开始开发?看看官方的 Model Context Protocol 文档,试试 Python、JavaScript 等语言的开源 SDK。

5

互动环节

-

你在开发中遇到过哪些 AI 集成难题? MCP

能如何解决你的痛点?

欢迎在评论区分享你的应用场景和挑战,或者提出对 MCP 未来发展的期待。让我们一起探索 AI 工具集成的新边界!